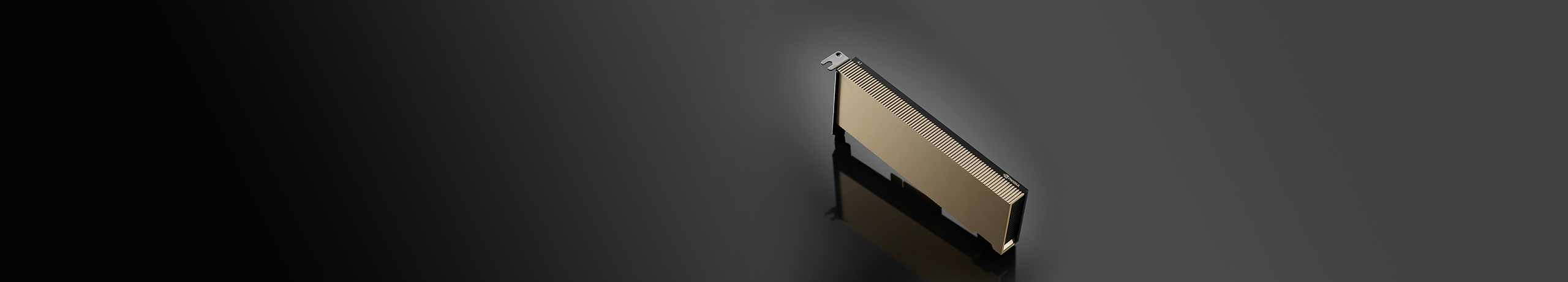

NVIDIA A2 Tensor Core GPU

GPU na poziomie podstawowym, który wprowadza NVIDIA AI do każdego serwera.

GPU NVIDIA A2 Tensor Core zapewnia wnioskowanie na poziomie podstawowym przy niskim zużyciu energii, małym rozmiarze oraz wysokiej wydajności dla NVIDIA AI na brzegu sieci. Wyposażony w niskoprofilową kartę PCIe Gen4 oraz konfigurowalną moc cieplną (TDP) wynoszącą 40-60W, A2 wprowadza wszechstronne przyspieszenie wnioskowania do każdego serwera, umożliwiając wdrożenie na dużą skalę.

Wnioskowanie AI jest wdrażane w celu wzbogacenia życia konsumentów poprzez inteligentne, interaktywne doświadczenia oraz pozyskiwania wniosków z bilionów czujników i kamer zlokalizowanych na końcach sieci. W porównaniu do serwerów opartych wyłącznie na CPU, serwery brzegowe i podstawowe z GPU NVIDIA A2 Tensor Core oferują do 20 razy wyższą wydajność wnioskowania, natychmiast podnosząc możliwości każdego serwera, aby móc obsługiwać nowoczesne AI.

Porównania jednego GPU NVIDIA A2 Tensor Core z procesorem Xeon Gold 6330N w konfiguracji z dwoma gniazdami

Konfiguracja systemu: CPU: HPE DL380 Gen10 Plus, 2S Xeon Gold 6330N @2.2GHz, 512GB DDR4

NLP: BERT-Large (Długość sekwencji: 384, SQuAD: v1.1) | TensorRT 8.2, Precyzja: INT8, BS:1 (GPU) | OpenVINO 2021.4, Precyzja: INT8, BS:1 (CPU)

Tekst na mowę: Tacotron2 + Waveglow end-to-end pipeline (długość wejściowa: 128) | PyTorch 1.9, Precyzja: FP16, BS:1 (GPU) | PyTorch 1.9, Precyzja: FP32, BS:1 (CPU)

Wizja komputerowa: EfficientDet-D0 (COCO, 512×512) | TensorRT 8.2, Precyzja: INT8, BS:8 (GPU) | OpenVINO 2021.4, Precyzja: INT8, BS:8 (CPU)

Serwery wyposażone w GPU NVIDIA A2 oferują do 1,3 razy wyższą wydajność w zastosowaniach inteligentnego brzegu, w tym w inteligentnych miastach, produkcji i handlu detalicznym. GPU NVIDIA A2 uruchamiające obciążenia IVA zapewniają bardziej efektywne wdrożenia, oferując do 1,6 razy lepszy stosunek ceny do wydajności oraz o 10 procent lepszą efektywność energetyczną w porównaniu do wcześniejszych generacji GPU.

NVIDIA A2 jest zoptymalizowane do obciążeń wnioskowania i wdrożeń w podstawowych serwerach, które mają ograniczenia dotyczące przestrzeni i wymagań cieplnych, takich jak środowiska brzegowe 5G i przemysłowe. A2 oferuje niski profil, operując w niskiej mocy, z TDP wynoszącym od 60W do 40W, co czyni go idealnym rozwiązaniem dla każdego serwera.

Wnioskowanie AI nadal napędza przełomowe innowacje w różnych branżach, w tym w internecie konsumenckim, opiece zdrowotnej i naukach przyrodniczych, usługach finansowych, handlu detalicznym, produkcji oraz superkomputeryzacji. Mały format i niski pobór mocy A2 w połączeniu z GPU Tensor Core NVIDIA A100 i A30 oferują kompleksowe portfolio wnioskowania AI w chmurze, centrum danych oraz na brzegu. A2 oraz portfolio wnioskowania AI NVIDIA zapewniają, że aplikacje AI są wdrażane z mniejszą liczbą serwerów i mniejszym zużyciem energii, co prowadzi do szybszych wniosków przy znacznie niższych kosztach.

NVIDIA AI Enterprise, kompleksowy zestaw oprogramowania AI i analizy danych natywnego w chmurze, jest certyfikowany do działania na A2 w wirtualnej infrastrukturze opartej na hypervisorach z VMware vSphere. To umożliwia zarządzanie i skalowanie obciążeń AI oraz wnioskowania w hybrydowym środowisku chmurowym.

Dowiedz się więcej o NVIDIA AI Enterprise

Systemy Certyfikowane przez NVIDIĘ™ z GPU NVIDIA A2 łączą przyspieszenie obliczeniowe oraz szybką, bezpieczną sieć NVIDIA w serwerach centrów danych przedsiębiorstw, zbudowanych i sprzedawanych przez partnerów OEM NVIDIĘ. Program ten pozwala klientom na identyfikację, nabywanie i wdrażanie systemów dla tradycyjnych oraz różnorodnych nowoczesnych aplikacji AI z katalogu NVIDIA NGC™ na jednej wysokowydajnej, opłacalnej i skalowalnej infrastrukturze.

Architektura NVIDIA Ampere jest zaprojektowana dla ery elastycznych obliczeń, dostarczając wydajność i przyspieszenie potrzebne do zasilania nowoczesnych aplikacji przedsiębiorstw. Odkryj serce najszybszych na świecie, elastycznych centrów danych.

Dowiedz się więcej o architekturze NVIDIA Ampere

Procesor graficzny NVIDIA A2 odgrywa kluczową rolę w zastosowaniach inteligentnych miast, zapewniając solidną moc obliczeniową niezbędną do przetwarzania i analiz danych w czasie rzeczywistym. Ten kompaktowy, ale wydajny procesor graficzny jest dostosowany do obliczeń brzegowych, umożliwiając efektywne wdrożenie w różnorodnych środowiskach miejskich. Niski pobór mocy i wysoka wydajność sprawiają, że idealnie nadaje się do zadań takich jak zarządzanie ruchem, gdzie może przetwarzać ogromne ilości danych wideo z kamer monitorujących w celu optymalizacji przepływu ruchu i zmniejszenia zatorów. Dodatkowo A2 może zwiększyć bezpieczeństwo publiczne poprzez rozpoznawanie twarzy w czasie rzeczywistym i wykrywanie anomalii, zapewniając szybką reakcję na potencjalne zagrożenia. Jego zastosowanie w systemach monitorowania środowiska pozwala również na analizę jakości powietrza i poziomu hałasu, przyczyniając się do zdrowszych warunków życia w miastach. Ogólnie rzecz biorąc, NVIDIA A2 przyspiesza wdrażanie inteligentnej infrastruktury, napędzając ewolucję inteligentniejszych i bardziej responsywnych miast.

Procesor graficzny NVIDIA A2 odgrywa kluczową rolę w rewolucjonizowaniu aplikacji detalicznych poprzez ulepszanie funkcjonalności opartych na sztucznej inteligencji, takich jak wizja komputerowa, analiza klientów i zarządzanie zapasami. Dzięki zaawansowanym funkcjom sztucznej inteligencji A2 może zapewniać analizę wideo w czasie rzeczywistym na potrzeby nadzoru w sklepie, umożliwiając skuteczniejsze zapobieganie stratom i analizę zachowań klientów. Sprzedawcy detaliczni mogą wykorzystać tę technologię do personalizacji doświadczeń zakupowych poprzez dynamiczne oznakowanie cyfrowe i promocje dostosowane do danych demograficznych i wzorców zachowań kupujących. Dodatkowo, solidna moc obliczeniowa A2 ułatwia automatyzację śledzenia zapasów i zarządzania nimi, zapewniając optymalny poziom zapasów i zmniejszając prawdopodobieństwo wyczerpania zapasów lub sytuacji nadmiernych zapasów. Integrując procesory graficzne NVIDIA A2, sprzedawcy detaliczni mogą osiągnąć znaczną poprawę wydajności operacyjnej, zadowolenia klientów i ogólnej wydajności biznesowej.

NVIDIA A2, część linii zaawansowanych procesorów graficznych NVIDIA, w coraz większym stopniu staje się kamieniem węgielnym w zastosowaniach produkcyjnych, wykorzystując swoje potężne możliwości sztucznej inteligencji i uczenia maszynowego w celu zwiększenia wydajności i precyzji. W zautomatyzowanych systemach kontroli jakości solidna moc obliczeniowa A2 umożliwia analizę obrazów produktów w czasie rzeczywistym, identyfikację defektów z dużą dokładnością i zapewnienie stałych standardów jakości. Co więcej, w ramach konserwacji predykcyjnej A2 przetwarza ogromne ilości danych z czujników, aby przewidzieć awarie sprzętu, zanim one wystąpią, redukując przestoje i koszty konserwacji. Jego zastosowanie w systemach zrobotyzowanych zwiększa automatyzację, gdzie zdolność procesora graficznego do przetwarzania złożonych algorytmów i wykonywania zadań głębokiego uczenia się pozwala robotom wykonywać skomplikowane procesy produkcyjne z precyzją i szybkością. Integrując kartę NVIDIA A2 z procesami produkcyjnymi, firmy mogą osiągnąć znaczny postęp w zakresie produktywności, zapewnienia jakości i wydajności operacyjnej.

Procesor graficzny NVidia A2 jest idealnym rozwiązaniem do zastosowań związanych z wnioskowaniem brzegowym ze względu na równowagę pomiędzy wydajnością energetyczną i wydajnością. Zaprojektowany specjalnie do obciążeń AI, A2 jest wyposażony w architekturę Ampere, zawierającą zaawansowane rdzenie tensorowe, które przyspieszają głębokie uczenie się i zadania AI. Kompaktowa obudowa i niskie zużycie energii sprawiają, że nadaje się do wdrożenia w środowiskach brzegowych, gdzie kluczowa jest przestrzeń i efektywność energetyczna. A2 umożliwia przetwarzanie w czasie rzeczywistym dużych ilości danych blisko źródła, redukując opóźnienia i wykorzystanie przepustowości w porównaniu z wnioskowaniem opartym na chmurze. Dzięki temu idealnie nadaje się do zastosowań takich jak pojazdy autonomiczne, inteligentne miasta i przemysłowy Internet Rzeczy, gdzie niezbędne jest szybkie podejmowanie decyzji i analityka w czasie rzeczywistym. Dodatkowo A2 obsługuje szeroką gamę frameworków i narzędzi AI, upraszczając integrację i wdrażanie modeli AI na krawędzi.

| Peak FP32 | 4.5 TF | |

| TF32 Tensor Core | 9 TF | 18 TF¹ | |

| BFLOAT16 Tensor Core | 18 TF | 36 TF¹ | |

| Peak FP16 Tensor Core | 18 TF | 36 TF¹ | |

| Peak INT8 Tensor Core | 36 TOPS | 72 TOPS¹ | |

| Peak INT4 Tensor Core | 72 TOPS | 144 TOPS¹ | |

| RT Cores | 10 | |

| Media engines | 1 video encoder 2 video decoders (includes AV1 decode) |

|

| GPU memory | 16GB GDDR6 | |

| GPU memory bandwidth | 200GB/s | |

| Interconnect | PCIe Gen4 x8 | |

| Form factor | 1-slot, low-profile PCIe | |

| Max thermal design power (TDP) | 40–60W (configurable) | |

| Virtual GPU (vGPU) software support² | NVIDIA Virtual PC (vPC), NVIDIA Virtual Applications (vApps), NVIDIA RTX Virtual Workstation (vWS), NVIDIA AI Enterprise, NVIDIA Virtual Compute Server (vCS) | |

Poznaj najnowocześniejsze technologie architektury NVIDIA Ampere.